Hellre Captain America än Konstapel Algoritm

Polisen i New Orleans har i hemlighet använt algoritmer för att identifiera potentiella brottslingar. Superhjälten Captain America skulle vara djupt kritisk.

– Vi kommer att neutralisera många hot innan de ens har hänt.

– Jag trodde att bestraffningen vanligtvis kom efter brottet?

– Vi har inte råd att vänta så länge.

Den mest betydelsebärande scenen i Captain America: The Winter Soldier handlar om synen på preventiv terrorbekämpning.

Nick Fury, chefen för den topphemliga underrättelseorganisationen SHIELD, har precis förevisat sin framtidsvision.

Ett nätverk av satelliter och luftskepp med kapacitet att slå till var som helst, när som helst, står reda att sjösättas.

Måltavlorna har tagits fram av en algoritm. Baserat på politiska sympatier och personliga nätverk har de som kommer att utvecklas till framtidens terrorister identifierats. Och nu ska de elimineras.

Fury är inte en skurk. Intentionerna är goda. Ett par tiotusen riktade avrättningar och världen kommer att förvandlas till en säker plats. Ett förlovat land där alla kan leva i frihet.

Men Captain America är inte övertygad. Han pekar mot det luftburna hangarfartyget.

– Det här är inte frihet, det här är fruktan.

Superhjältefilmen från 2014 tangerade den klassiska frågeställningen om moraliska målkonflikter. Hur mycket ont kan vi göra för att uppnå något gott? Finns det en gräns när det onda vi gör gör oss onda?

Nu håller verkligheten på att närma sig scenariot i filmen.

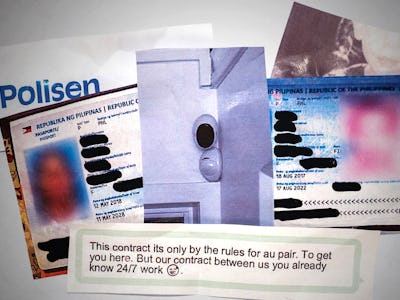

Techsajten The Verge har kartlagt hur dataanalysföretaget Palantir i hemlighet använt New Orleans som ett levande laboratorium för produktutveckling.

Med borgmästarens godkännande och i samarbete med den lokala ordningsmakten, men i övrigt dolt från folkvalda och allmänhet syftade pilotprojektet till att förbättra företagets algoritm för ”prediktivt polisarbete”.

Algoritmen matades med spaningsrapporter, belastningsregister, socioekonomisk statistik och sociala medier-historik. Och spottade i gengäld ur sig listor över människor i farozonen för att begå eller falla offer för brott.

Jazzens hemstad är inte ett isolerat exempel.

Palantir, döpt efter den allseende stenen från Sagan om ringen och grundat med stöd av CIA:s riskkapitalbolag IQT, har sålt mjukvara till ett flertal aktörer med tveksam historik vad gäller respekt för mänskliga rättigheter.

Israel använder teknologin för att hitta de ”ensamvargar” som det vanliga underrättelsenätet inte fångar upp.

Även Danmark har hoppat på tåget och köpt programvara för att söka upp tänkbara terrorister.

I teorin finns det legitima användningsområden. Tänk om socialtjänsten visste på individnivå var uppsökande insatser behövs. I praktiken ser det annorlunda ut.

Så länge vi inte har fullständigt värdeneutrala data kan algoritmen inte leverera en rättvis prognos om vilka som kan tänkas bli brottslingar i framtiden.

Fattiga som utsätts för polisdiskriminering och i högre utsträckning lagförs för småbrott är mer sannolika att framhållas som farliga.

I stället för trygghet riskerar utfallet att bli repression och skapa mänskliga tragedier. Algoritmernas godtycke illustrerar även de digitala förutsägelsernas olösliga dilemma.

Verkligheten har inget facit.